O Fim do "Ouro Digital": Por que a Inteligência Artificial do Futuro Dependerá da Imperfeição Humana

Como o fenômeno do "Colapso do Modelo" está transformando o conteúdo humano autêntico no artivo de maior luxo da indústria de tecnologia.

"A máquina não erra por falta de inteligência. Ela erra por excesso de consenso."

A Ilusão da Geração Infinita

Existe uma crença silenciosa que foi se instalando nos últimos anos, especialmente entre quem lida com tecnologia no dia a dia: a de que o conteúdo passou a ser um recurso ilimitado. Texto, imagem, código, análise jurídica, roteiro de vídeo — tudo isso parece estar a um prompt de distância. A IA não dorme, não cobra hora extra, não tem bloqueio criativo numa segunda-feira de manhã.

Essa percepção não é completamente falsa. Ela é, porém, perigosamente incompleta.

O que os grandes modelos de linguagem produzem não é criação. É, na melhor definição técnica possível, uma média estatística ponderada de tudo que a humanidade já escreveu. O texto gerado é coerente, fluido, bem-pontuado — e profundamente plano. Falta-lhe o que nenhum gradiente descendente consegue capturar: a borra no fundo de um copo de café numa manhã em Belém, o ângulo torto de uma foto tirada às pressas no metrô de São Paulo, a gíria que nasceu num grupo de WhatsApp e ainda não chegou ao Wikipédia. A máquina não tem vivência. Ela tem probabilidade.

E é exatamente aí que começa o problema mais sério que a indústria de inteligência artificial enfrentará na próxima década — um problema que já tem nome, já tem artigos publicados na Nature, e ainda assim é pouco discutido fora dos círculos técnicos: o Colapso do Modelo.

O Paradoxo do "Colapso do Modelo"

O Conceito Técnico (Acessível)

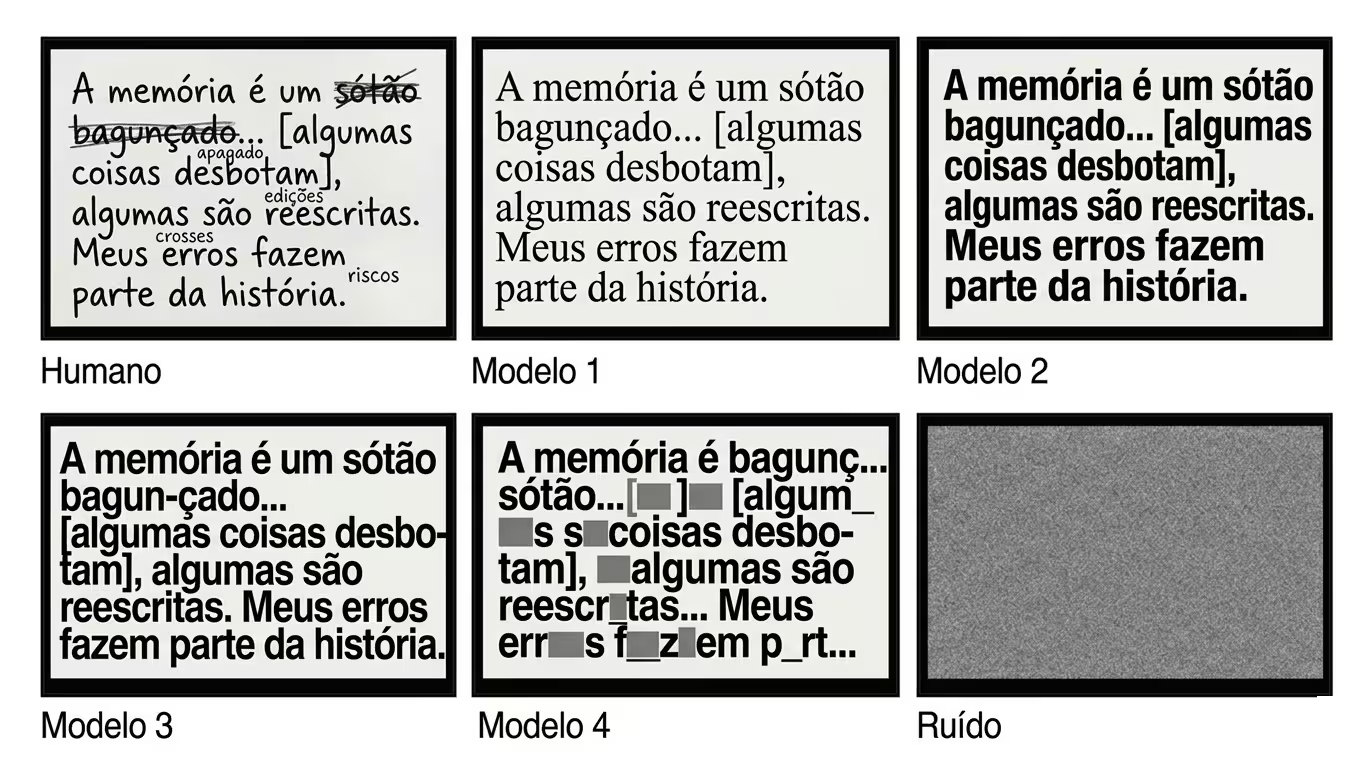

Model Collapse — ou Colapso do Modelo — é o processo pelo qual um modelo de linguagem se degrada progressivamente quando é treinado, em ciclos sucessivos, sobre dados gerados por outros modelos de IA.

A lógica é simples e brutal: os grandes modelos são treinados raspando a internet. A internet, por sua vez, está sendo inundada de conteúdo gerado por IA. Quando um novo modelo é treinado sobre esse material contaminado, ele aprende não a partir da experiência humana bruta, mas a partir de uma cópia estatística dessa experiência. O modelo seguinte aprende a partir da cópia da cópia. E assim por diante.

Pesquisadores demonstraram que treinar modelos generativos de forma indiscriminada sobre conteúdo real misturado a conteúdo gerado por IA — como ocorre no scraping de dados da internet — pode levar ao colapso da capacidade dos modelos de produzir resultados diversos e de alta qualidade.

O estudo seminal foi publicado na Nature em 2024, pelo pesquisador Ilia Shumailov e colaboradores. A conclusão é direta: o uso indiscriminado de conteúdo gerado por modelos no treinamento causa defeitos irreversíveis nos modelos resultantes, nos quais as caudas da distribuição original do conteúdo desaparecem.

"Caudas da distribuição" é uma forma técnica de dizer: as nuances, as perspectivas de minoria, os raciocínios não-convencionais, as vozes periféricas. Tudo aquilo que não é "estatisticamente médio".

A Analogia da Fotocópia

Pense no processo como tirar uma fotocópia de uma fotocópia, repetidas vezes. Na primeira cópia, você perde um pouco do contraste. Na segunda, o texto começa a ficar borrado nas bordas. Na quinta, alguns caracteres se tornam ilegíveis. Na décima, o que resta é uma mancha cinza com vestígios do documento original.

Quando você alimenta um modelo repetidamente com seus próprios resultados, padrões raros desaparecem e o sistema deriva em direção a médias genéricas.

O resultado prático? Modelos que respondem de forma cada vez mais homogênea, que "alucinam" com mais frequência justamente nos casos de borda — os casos raros, complexos, não-convencionais — e que perdem progressivamente a capacidade de surpreender ou de capturar a riqueza do espectro humano de pensamento.

Pesquisas em grandes modelos de linguagem encontraram que treinar LLMs em textos gerados por modelos predecessores causa uma redução consistente na diversidade lexical, sintática e semântica dos resultados do modelo ao longo de iterações sucessivas, sendo especialmente notável em tarefas que exigem altos níveis de criatividade.

A ironia é filosófica e quase perversa: a IA está se tornando menos capaz exatamente onde o ser humano é mais insubstituível.

O Estado Atual da Contaminação

O problema não é hipotético nem distante. Em abril de 2025, 74,2% das páginas da web recém-criadas continham algum texto gerado por IA. Páginas escritas por IA nos 20 primeiros resultados do Google saltaram de 11,11% para 19,56% entre maio de 2024 e julho de 2025.

Isso significa que os modelos que estão sendo treinados hoje já estão consumindo uma internet parcialmente sintética. E os modelos de amanhã consumirão uma internet ainda mais sintética. O ciclo se retroalimenta — e, sem intervenção deliberada, ele converge para a mediocridade.

É por isso que, nos bastidores da indústria, empresas estão fechando acordos de licenciamento de conteúdo real para manter os modelos ancorados na realidade — como o Reddit com o Google e a News Corp com a OpenAI. Esses movimentos não podem ser descartados como simples estratégias de relações públicas.

O dado humano autêntico virou commodity estratégica. E o mercado ainda não precificou isso corretamente.

A Nova Economia do Dado Humano

Quando o "Insumo" Vira Luxo

Durante anos, o discurso dominante da economia digital foi o de que o ser humano seria progressivamente deslocado das funções de produção intelectual. A IA escreveria, a IA codificaria, a IA criaria. O humano seria, quando muito, o operador do prompt.

Esse discurso não está errado. Está incompleto — e a incompletude é cara.

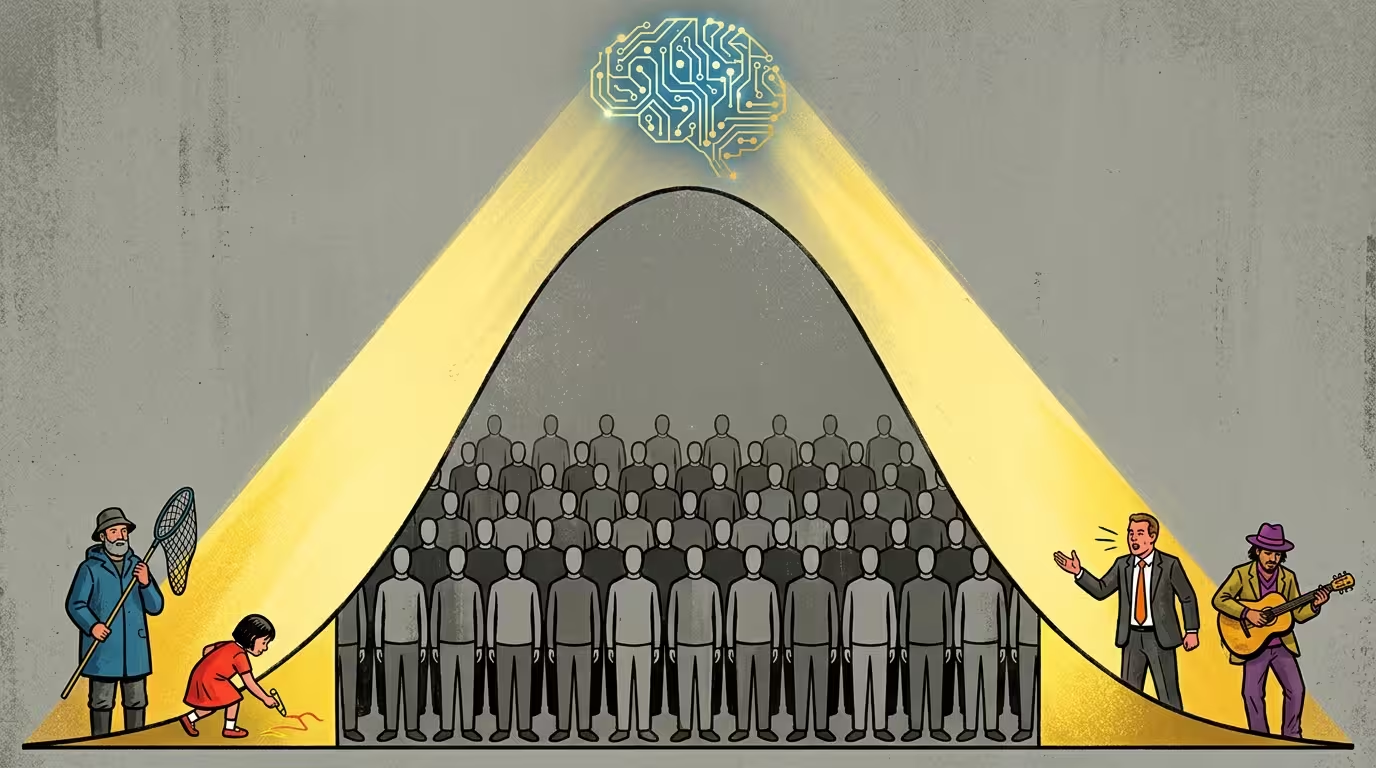

O que o Colapso do Modelo revela é uma virada de lógica econômica: em um mundo onde o conteúdo gerado por IA é abundante e barato, o conteúdo genuinamente humano torna-se escasso e caro. A lei da oferta e demanda não para na porta dos laboratórios de machine learning.

Não estamos mais falando de resolver captchas ou rotular imagens. As grandes empresas de tecnologia já estão ativamente buscando dados de "cauda longa" — experiências genuínas, raciocínios complexos diante de dilemas reais, opiniões não-convencionais, perspectivas culturais periféricas, criatividade crua e não polida. O humano deixa de ser o operador da máquina para se tornar o fornecedor de nutrição de alta qualidade para os algoritmos.

Esse é um mercado emergente que ainda não tem nome, mas já tem forma. E ele vai remunerar de forma muito desigual: quem produz pensamento genérico e formatado vai competir diretamente com a IA — e perder. Quem produz pensamento original, contraditório, situado e radicalmente humano vai se tornar um ativo.

Aliás, já exploramos neste blog como os mecanismos de atenção da economia digital transformam o comportamento humano em dado — e o Colapso do Modelo é, em certa medida, a consequência técnica desse processo levado ao extremo: quando toda a produção humana é mediada e amplificada por algoritmos, o que sobra para treinar a próxima geração de algoritmos?

O Paradoxo da Autenticidade Rentável

Existe algo quase irônico nessa virada. A indústria que passou anos tentando sistematizar, automatizar e escalar a produção de conteúdo agora descobre que precisa, desesperadamente, de algo que por definição não pode ser sistematizado: a singularidade.

A perspectiva de um pescador artesanal do Marajó sobre as mudanças climáticas não está em nenhum dataset. O raciocínio de uma mãe solo que criou filhos durante uma crise econômica sobre resiliência financeira não foi capturado por nenhum paper acadêmico. O humor específico de uma quebrada de Fortaleza, o argot de um grupo de desenvolvedores sênior, a sabedoria acumulada de um médico com 30 anos de prática em comunidade — esses dados são raros, situados, e irreplicáveis.

É exatamente o tipo de dado que os próximos modelos precisarão para não colapsarem sobre si mesmos.

A Aplicação no Mundo Real: O Futuro das Profissões

O Caso do Direito (e do Conhecimento em Geral)

Vamos aterrar essa discussão em um exemplo concreto, porque abstrações filosóficas sem ancoragem prática são fáceis de ignorar.

Considere a prática jurídica. Já é possível — e cada vez mais comum — usar modelos de linguagem para redigir petições, consultar jurisprudência, identificar precedentes e formatar documentos processuais. A IA faz isso com eficiência, consistência e velocidade que nenhum estagiário consegue replicar.

Mas existe uma distinção fundamental que raramente aparece nas análises sobre "IA e o futuro do direito": a diferença entre o trabalho técnico-processual e o raciocínio jurídico estratégico.

A IA será perfeitamente capaz de redigir a petição padrão — impecável na forma, completa na jurisprudência básica, formatada segundo as normas do tribunal. O que ela não conseguirá sintetizar, a partir de um treinamento sobre textos genéricos, é a tese orgânica construída a partir da escuta atenta de um cliente, a interpretação crua da dor social por trás de um litígio trabalhista, a aplicação de uma lógica argumentativa nova a um problema que ainda não tem precedente consolidado.

O trabalho braçal — o volume, a formatação, a pesquisa de base — será automatizado. A sagacidade humana ganha um prêmio de mercado.

Isso não é otimismo ingênuo sobre o futuro do trabalho. É uma consequência direta da arquitetura técnica do problema: os modelos colapsam nas caudas da distribuição, e é exatamente nas caudas que vive o pensamento mais valioso.

Vale lembrar que a relação entre as grandes empresas de IA e as demandas do Estado — inclusive no campo jurídico e de segurança — já está sendo negociada em níveis que vão muito além do uso pessoal. Como mostramos em nossa cobertura sobre o acordo entre a Anthropic e o Pentágono, os modelos de linguagem já operam em contextos institucionais de alta complexidade — o que torna a questão da qualidade dos dados de treinamento ainda mais crítica.

Além do Direito: O Princípio Geral

O mesmo raciocínio se aplica a praticamente qualquer área de conhecimento especializado:

- Medicina: A IA diagnostica com base em padrões estatísticos. O médico que acumula anos de prática em uma comunidade específica reconhece as exceções.

- Jornalismo: A IA agrega, formata e resume. O repórter que passou noites em uma favela ou numa zona de conflito captura o que nenhum algoritmo alcança.

- Educação: A IA explica o conteúdo canônico com clareza. O professor que conhece a história de cada aluno adapta a abordagem de formas que nenhum modelo generalista prevê.

Em todos esses casos, o valor se desloca da execução técnica para o julgamento situado, para a experiência encarnada, para o que poderíamos chamar — sem romantismo excessivo — de sabedoria.

A comparação entre os grandes modelos disponíveis hoje, como discutimos em nossa análise Gemini vs. Claude em 2026, já revela diferenças significativas em como cada modelo lida com raciocínio de borda e casos não-convencionais. Essas diferenças não são acidentais: elas refletem escolhas distintas sobre curadoria de dados — e, no fundo, sobre qual tipo de humanidade cada modelo decidiu absorver.

Conclusão: A Imperfeição Como Vantagem Competitiva

Há uma certa poesia amarga no que o Colapso do Modelo revela sobre o projeto da inteligência artificial.

Durante décadas, o ideal tecnológico foi a eficiência perfeita: eliminar o erro, eliminar a variação, eliminar o ruído. A IA era a promessa de um mundo sem as inconveniências da imperfeição humana. Textos sem ambiguidade, análises sem viés, respostas sem hesitação.

O que o Colapso do Modelo nos mostra é que a imperfeição humana não era o problema a ser resolvido. Era, o tempo todo, o dado mais valioso do sistema.

As gírias que mudam a cada geração. Os argumentos que contradizem a si mesmos mas capturam uma tensão real. Os textos escritos com raiva, com saudade, com ironia não-linear. Os erros gramaticais que sinalizam uma voz autêntica. Tudo isso que os sistemas de curadoria de dados filtraram como "ruído" era, na verdade, o sinal mais rico.

A indústria está aprendendo isso da forma mais cara possível: construindo modelos cada vez maiores sobre dados cada vez mais sintéticos, e colhendo resultados cada vez mais genéricos.

A resposta não é o ludismo — não se trata de rejeitar a IA, mas de entender sua ecologia. Os modelos precisam de dados humanos como os ecossistemas precisam de biodiversidade: não como enfeite, mas como condição de sobrevivência. Uma floresta homogênea é frágil. Um modelo treinado apenas em conteúdo sintético também.

Para quem produz conhecimento — escritores, pesquisadores, juristas, educadores, jornalistas, criadores de conteúdo — essa é uma notícia ambivalente, mas fundamentalmente boa: o mercado está prestes a remunerar, de forma inédita, exatamente o que a máquina não consegue fazer. Não a execução perfeita do padrão, mas a ruptura informada do padrão. Não a média, mas a cauda.

O "ouro digital" não era o dado em si. Era a imperfeição irreproduzível embutida nele.

E nenhum modelo de linguagem, por mais bem treinado que seja, vai conseguir sintetizar isso do nada.

Gostou da análise? Compartilhe.

Fontes e leituras recomendadas:

- Shumailov, I. et al. AI models collapse when trained on recursively generated data. Nature, 631, 755–759, 2024.

- Strong Model Collapse — ICLR 2025. OpenReview, 2025.